Suivez les sentiers de l’IA | Vers la science des données

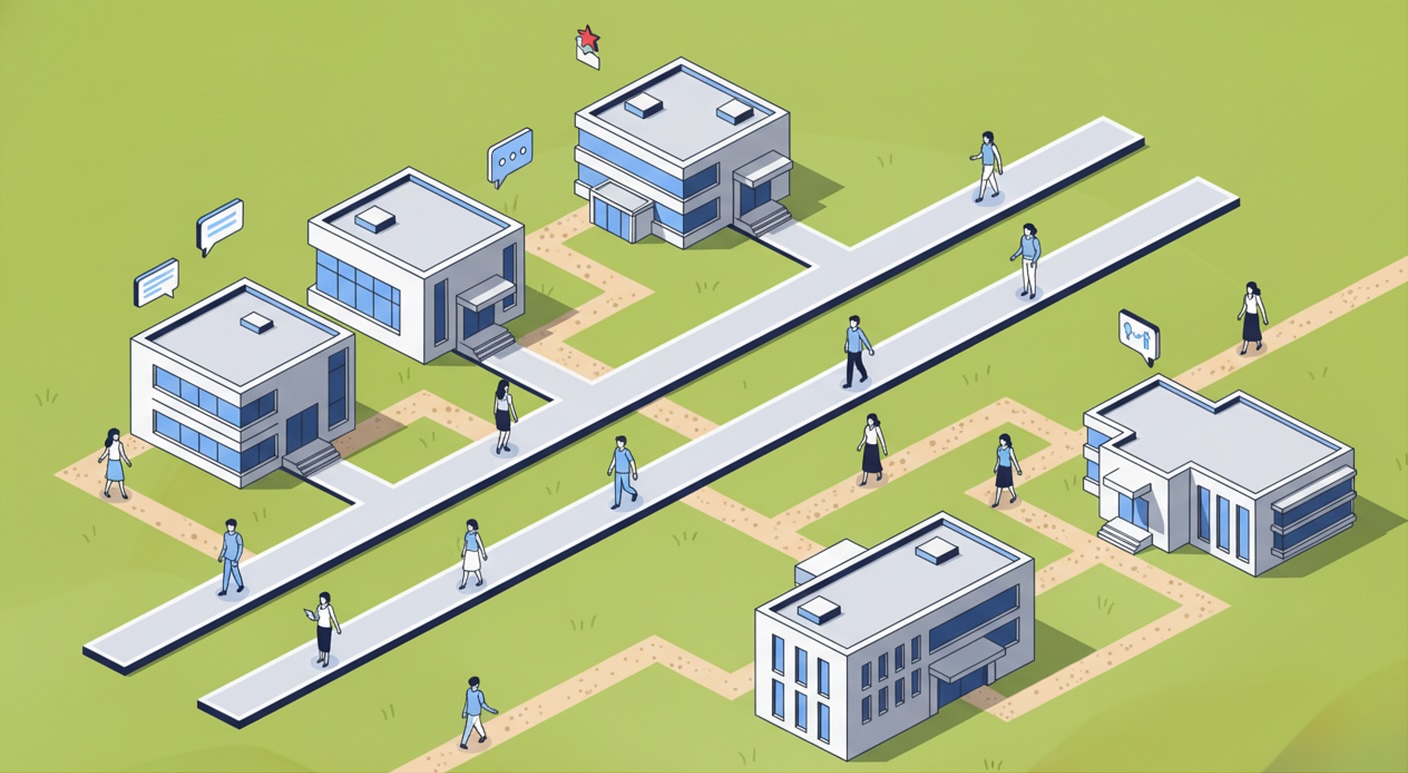

n’importe quel parc urbain et vous remarquerez des sentiers de terre étroits traversant l’herbe. Ils apparaissent entre les trottoirs, sur les pelouses et dans les coins que les planificateurs n’avaient jamais prévu que les gens traversent.

Les urbanistes appellent cela chemins de désir.

Ils se forment lorsque les gens choisissent leurs propres itinéraires plutôt que les voies officielles. Au fil du temps, l’herbe disparaît et le sentier informel devient une preuve visible de la manière dont les gens se déplacent réellement dans un espace.

Pendant des décennies, les planificateurs ont traité ces tracés comme des erreurs. Aujourd’hui, beaucoup les voient différemment. Les chemins du désir révèlent quelque chose de précieux. Ils montrent où la conception originale ne correspondait pas au comportement humain.

Quelque chose de similaire se produit dans les organisations modernes.

Les employés utilisent déjà l’intelligence artificielle pour rédiger des e-mails, analyser des données, résumer des documents et générer des idées. Un responsable marketing peut utiliser un modèle linguistique pour préparer le texte de la campagne. Un analyste financier peut résumer les rapports avec un assistant IA. Un chef de produit peut tester des idées grâce à des outils génératifs.

Souvent, cette expérimentation se déroule discrètement, en dehors des systèmes ou politiques officiels.

Ce phénomène a un nom : Shadow AI.

Le terme fait écho au concept plus ancien du shadow IT, lorsque les employés installaient des logiciels sans l’approbation des services informatiques de l’entreprise. Aujourd’hui, le schéma se répète avec l’intelligence artificielle. Les travailleurs intègrent des outils génératifs dans leurs flux de travail quotidiens bien avant que les organisations n’établissent des structures de gouvernance ou des plateformes approuvées.

Cela soulève des préoccupations évidentes. Les informations sensibles de l’entreprise peuvent pénétrer dans des systèmes externes sans visibilité claire sur la manière dont ces données sont traitées ou stockées. Les cadres réglementaires tels que le RGPD ou la loi européenne sur l’IA peuvent être violés involontairement. Les équipes de sécurité perdent la surveillance de la façon dont les informations circulent dans l’organisation.

Pourtant, se concentrer uniquement sur le risque passe à côté de quelque chose d’important.

L’IA fantôme révèle souvent où les systèmes existants ne suivent plus la façon dont les gens doivent travailler. Comme les chemins de désir dans un parc, Shadow AI révèle où les employés recherchent des moyens plus rapides et plus intelligents pour accomplir leurs tâches quotidiennes.

Si ce comportement était rare, il pourrait être gérable. Les chiffres suggèrent le contraire.

Des enquêtes indiquent que près de quatre personnes sur cinq utilisant l’IA au travail apportent leurs propres outils plutôt que de compter sur les systèmes fournis par leur employeur. Beaucoup interagissent avec ces outils via des comptes personnels au lieu de plateformes d’entreprise conçues pour protéger les données sensibles.

Les conséquences commencent à se faire sentir. Des études suggèrent que plus de la moitié des employés admettent avoir saisi des informations confidentielles dans les systèmes d’IA. Organisations confrontées à une utilisation généralisée de Shadow AI signaler des coûts de violation plus élevés et une plus grande exposition au risque réglementaire.

En d’autres termes, l’intelligence artificielle se répand déjà à grande échelle sur les lieux de travail. Les cadres de gouvernance, de formation et de sécurité arrivent plus tard.

Cet écart crée de réels risques. Cela révèle également la manière dont le changement technologique se déroule réellement au sein des organisations.

L’IA fantôme comme signal organisationnel

Il existe une autre façon d’interpréter Shadow AI.

Lorsque les employés adoptent de nouveaux outils en dehors des canaux officiels, ils ne contournent pas seulement les structures de gouvernance. Ils révèlent également où les flux de travail existants échouent.

Dans de nombreuses organisations, l’IA générative apparaît d’abord en marge du travail quotidien. Les employés expérimentent la rédaction d’e-mails plus rapidement, la synthèse de documents, l’analyse de feuilles de calcul, la préparation de présentations ou l’exploration d’idées. Ces expériences se déroulent discrètement car les systèmes officiels dont elles disposent ne prennent pas encore en charge ces capacités.

Ce que les équipes de sécurité considèrent comme une utilisation non autorisée peut donc fonctionner comme une forme de diagnostic organisationnel. Shadow AI révèle où les gens tentent de se déplacer plus rapidement que les systèmes qui les entourent ne le permettent.

Les penseurs urbains observent depuis longtemps une tendance similaire dans les villes. Jane Jacobs a soutenu que les villes devraient être conçues en fonction de la manière dont les gens s’y déplacent réellement, et non en fonction de la façon dont les planificateurs imaginent qu’elles devraient le faire. Les sentiers informels traversant les parcs et les campus fournissent une carte des comportements réels.

Les organisations confrontées à la montée en puissance de l’IA fantôme devront peut-être adopter le même état d’esprit.

Au lieu de considérer l’IA fantôme uniquement comme un échec de gouvernance, les dirigeants peuvent la considérer comme un signal précoce des domaines dans lesquels l’intelligence artificielle pourrait apporter la plus grande valeur. Les expériences informelles qui apparaissent au sein des équipes mettent souvent en évidence des flux de travail dans lesquels l’automatisation, l’augmentation ou un meilleur accès à l’information pourraient augmenter considérablement la productivité.

Lorsque les organisations abordent ces modèles avec curiosité plutôt qu’avec crainte, les expériences dispersées commencent à révéler quelque chose de précieux. Ils mettent en évidence les tâches répétitives que les employés tentent déjà d’accélérer et exposent les processus pour lesquels de meilleurs outils pourraient générer des gains d’efficacité significatifs.

Ce qui semble chaotique au premier abord laisse souvent entrevoir des opportunités de consolidation. Au lieu de dizaines d’expériences fragmentées entre départements, les organisations peuvent identifier des besoins communs et créer autour d’eux des solutions gouvernées et évolutives.

Bien géré, ce changement fait plus que réduire les risques. Il donne aux employés des outils sécurisés qui soutiennent leur façon de travailler déjà, transformant l’intelligence artificielle de quelque chose qui nécessite une supervision constante en un multiplicateur de créativité et d’innovation. Ignorer Shadow AI signifie manquer ces signaux. Cela permet à des expériences coûteuses et non coordonnées de se poursuivre dans l’ombre tandis que les organisations négligent les informations qui pourraient guider une adoption plus intelligente.

Apprendre des sentiers de l’IA

Les organisations qui souhaitent gouverner efficacement l’intelligence artificielle doivent d’abord comprendre comment elle est déjà utilisée.

Shadow AI ne doit pas être étudié uniquement comme un problème de conformité. Il doit être examiné comme un signal indiquant où les employés tentent d’avancer plus rapidement que ne le permettent les systèmes qui les entourent. La première étape est la visibilité. Les dirigeants doivent comprendre quels outils les employés utilisent déjà et pourquoi. Les enquêtes auprès des employés, les audits techniques et les discussions ouvertes entre les départements révèlent souvent où l’expérimentation a lieu en premier. Les équipes marketing, commerciales, financières, RH et produits apparaissent souvent comme les premiers à adopter cette solution.

Une fois que ces schémas deviennent visibles, le défi passe de la suppression à la structure. Les organisations doivent définir les outils appropriés, établir des politiques de gouvernance alignées sur la sensibilité des données et la réglementation, et concevoir des processus qui reflètent la manière dont le travail se déroule réellement au sein de l’organisation.

La culture compte tout autant que la politique. Les employés devraient se sentir en sécurité en discutant de la manière dont ils expérimentent l’intelligence artificielle plutôt que de la cacher. Lorsque les gens craignent des sanctions ou une charge de travail supplémentaire pour avoir adopté de nouveaux outils, l’expérimentation ne disparaît pas. Il se déplace simplement plus loin dans l’ombre.

Une gouvernance efficace nécessite donc plus que des règles. Cela nécessite un environnement dans lequel l’expérimentation responsable est encouragée et guidée. La formation, l’accès à des outils approuvés et des garde-fous clairs permettent aux organisations de transformer des expériences dispersées en progrès coordonnés.

Comprendre ce qui existe déjà dans l’ombre est souvent la première étape vers l’élaboration d’une stratégie d’IA résiliente et intelligente.

Une dernière pensée

En pratique, Shadow AI est rarement le résultat de la malveillance. Le plus souvent, cela reflète un désalignement et un manque de communication au sein de l’organisation. Lorsque les employés ne se sentent pas en sécurité pour partager leurs expériences, lorsque la curiosité se heurte avant tout à une correction, le résultat prévisible est le silence.

Les gens n’arrêtent pas d’expérimenter. Ils arrêtent simplement de partager.

Si les organisations veulent gouverner efficacement l’IA, elles doivent commencer par créer des environnements où une exploration réfléchie est possible. La formation, les exemples pratiques et les garde-fous clairs rendent l’expérimentation responsable visible plutôt que cachée.

Mais c’est la culture qui compte le plus. Lorsque la curiosité remplace la suspicion, l’expérimentation sort de l’ombre et s’ouvre au grand jour.

La première étape vers la gouvernance de Shadow AI est simple : comprendre où les gens marchent déjà.

À propos d’Alexandra Osipova

Aleksandra Osipova est la fondatrice de Laboratoire Apricityoù elle travaille avec des dirigeants et des organisations qui naviguent dans la transition vers des systèmes basés sur l’IA.

Elle écrit sur l’intelligence artificielle, la pensée systémique et l’avenir du travail. Plus de son travail et de ses idées peuvent être trouvés sur elle LinkedIn.