Le mandat Data 2026 : votre architecture de gouvernance est-elle une forteresse ou un handicap ?

de la gouvernance des données

La gouvernance des données est la processus structuré et continu de gestion des données d’une organisation pour garantir sa disponibilité, sa convivialité, son intégrité et sa sécurité. Cela implique la mise en place d’un cadre de rôles, de politiques, de normes et de mesures qui contrôlent la manière dont les données sont créées, utilisées, stockées et protégées tout au long de leur cycle de vie.

La gouvernance des données est apparue comme une pratique formelle au début des années 2000, où l’accent était mis sur la sécurité de base et le contrôle d’accès, généralement hébergés au sein du service informatique. Déclenchés par les crises financières et les violations de données, les premiers cadres de gouvernance des données n’étaient que des « cases à cocher », le RGPD et la gestion des données pour atténuer les risques. Avance rapide jusqu’en 2025, avec le montée en puissance de l’IA agentiquela gouvernance des données est désormais intégrée aux flux de travail axés sur la préparation à l’IA, la qualité des données et le traçage en temps réel. D’ici 2026, les « délais de grâce » de nombreuses réglementations européennes prendront fin, marquant cette année comme «une année de calcul» pour la stratégie de données.

Règlements européens à connaître

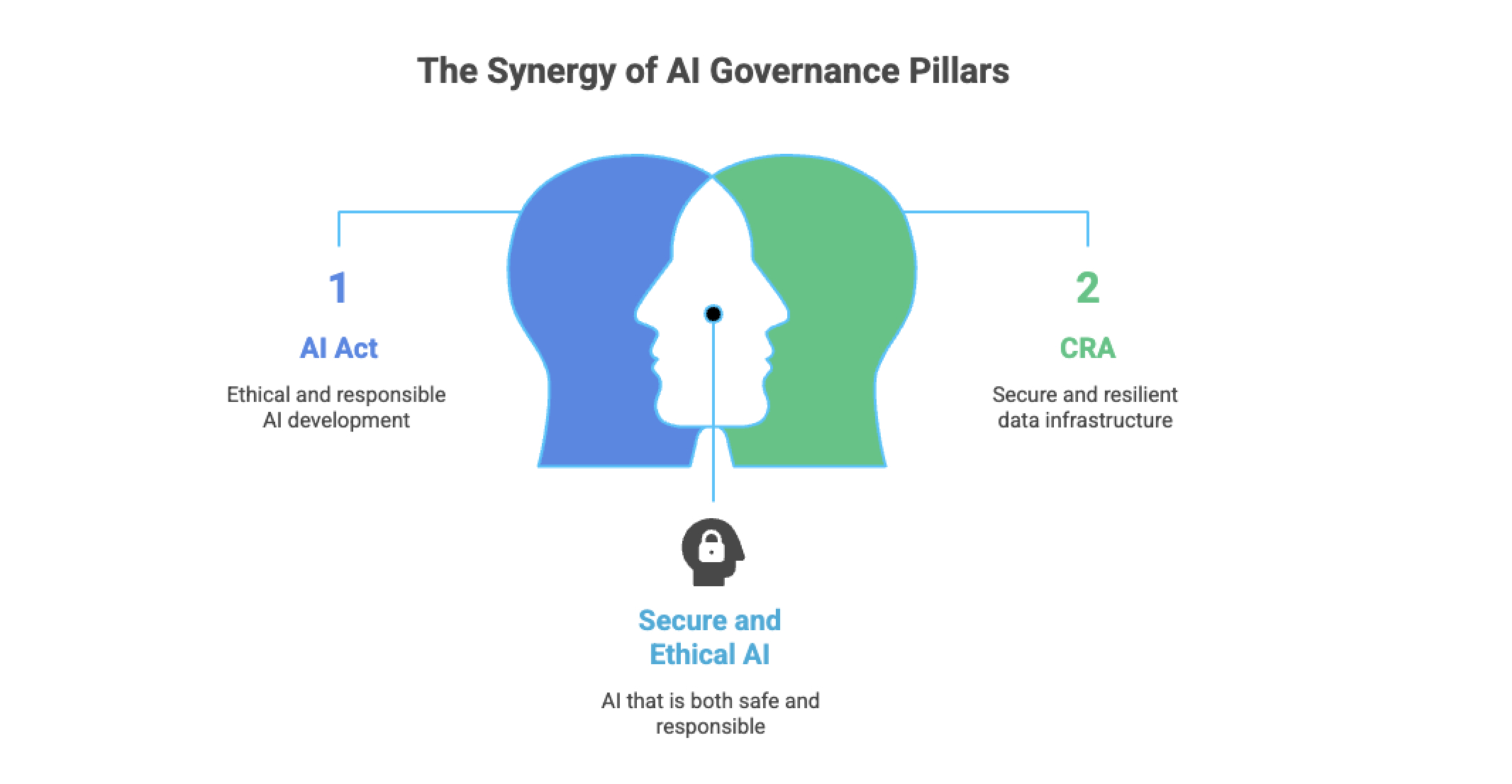

En 2026, les entreprises européennes ne peuvent plus se permettre de prendre la gouvernance à la légère. Avec la mise en œuvre complète de la loi européenne sur l’IA, de la loi sur la cyber-résilience (CRA) et de la loi sur les données, le coût des « données désordonnées » est passé d’une taxe sur les performances à une responsabilité juridique.

La loi européenne sur l’IA (le mandat qualité et éthique)

Alors que le Loi européenne sur l’IA entrée en vigueur en 2024, août 2026 est la date limite critique pour la plupart des systèmes d’IA « à haut risque » et des règles de transparence en matière d’IA à usage général (GPAI). Pour les systèmes d’IA « à haut risque », l’article 10 de la loi exige :

- Provenance des données : Vous devez prouver d’où proviennent vos données d’entraînement.

- Atténuation des biais : Surveillance active des ensembles de données « représentatifs » et « sans erreur ».

- Traçabilité : Une « trace écrite » technique de la manière dont les données ont influencé la décision d’un modèle.

D’ici 2026, le parcours documentaire est obligatoire. Le contenu généré par l’IA doit être marqué et étiqueté. Si un auditeur frappe à la porte, vous devriez être en mesure de retracer une décision jusqu’aux données exactes de la formation et aux mesures d’atténuation des biais prises dans le passé.

La loi sur la cyber-résilience (ARC)

Bien que la loi sur l’IA régisse le intelligencele ARC régit le navire. D’ici 2027, tout produit numérique dans l’UE devra porter le marquage CE, prouvant qu’il répond à des normes strictes de cybersécurité. Les fabricants de produits numériques doivent signaler activement les vulnérabilités exploitées à l’ENISA dans les 24 heures. Les entreprises doivent disposer d’une nomenclature logicielle (SBOM) – un inventaire en direct de chaque composant logiciel open source de leur pile. Pour la gouvernance des données, cela signifie :

- Cycles de vie des données sécurisés : Les données ne peuvent être gouvernées si le logiciel qui les gère est vulnérable.

- Divulgation de vulnérabilité : Les entreprises doivent désormais gérer leurs pipelines de données avec la même rigueur de sécurité que leurs transactions financières.

Le Data Act (la fin des silos de données)

Souvent éclipsée par l’AI Act, la Loi sur les données (déjà pleinement en vigueur à partir de septembre 2025) est peut-être plus perturbateur.

- Le droit à la portabilité : Il accorde aux utilisateurs (aussi bien B2B que B2C) le droit d’accéder et de partager les données générées par leur utilisation des produits connectés.

- Stratégie pivot : Les entreprises ne peuvent plus considérer les « données d’utilisation » comme leur atout exclusif. Votre stratégie de données 2026 doit inclure Partage de données dès la conception. Vous devez créer des API qui permettent à vos clients d’extraire leurs données et de les transmettre à un concurrent – dans des conditions équitables et non discriminatoires.

Le pivot 2026 : de la « case à cocher » au « By Design »

L’approche traditionnelle des « cases à cocher » s’est révélée efficace lorsque la gouvernance consistait en un audit annuel. Les entreprises doivent désormais passer d’un réactif nettoyage des données vers proactif architecture technique. La gouvernance devrait être intégrée « By Design » en 2026. Vous trouverez ci-dessous les trois changements technologiques qui se produisent dans cette direction :

- Des catalogues passifs aux métadonnées actives – Nous savons déjà que les systèmes d’IA à haut risque doivent disposer d’un « enregistrement de l’activité pour assurer la traçabilité ». Cela n’est possible qu’avec une plateforme de métadonnées active. Ces systèmes utilisent l’IA pour surveiller la pile de données en temps réel. Si un ensemble de données de formation est mis à jour, le système de métadonnées alerte instantanément les modèles d’IA en aval et enregistre la modification pour les audits futurs, créant ainsi une « trace écrite ».

- Couche sémantique universelle (ou « Version unique de la vérité ») – Les entreprises adoptent une couche sémantique universelle, qui est une couche middleware située entre vos données (Snowflake, Databricks, etc.) et vos agents d’IA. Votre chatbot IA ne peut pas donner une réponse et votre rapport financier une autre. Chaque outil doit utiliser la même logique métier. Des entreprises comme Snowflake (via Horizon Catalog) et Databricks (via Unity Catalog) fournissent une gouvernance intégrée à leurs clients plutôt qu’une couche supplémentaire.

- Zéro ETL et « flux de données sécurisé » – L’ARC exige que les produits numériques soient sécurisés tout au long de leur cycle de vie. Fini les pipelines ETL fragiles et codés à la main. Les architectures Zero ETL visent à réduire « l’empreinte des données » en minimisant le nombre de fois que les données sensibles sont copiées. Les scripts d’ingestion manuelle sont souvent les maillons les plus faibles où les données sont divulguées ou corrompues. Les formats de tableaux ouverts (comme Iceberg) permettent à différents outils de travailler sur les mêmes données sans aucune duplication.

Comment les agents d’IA assument le fardeau de la gouvernance

L’un des changements les plus excitants en 2026 est que nous utilisons enfin l’IA pour résoudre les problèmes créés par l’IA. Nous passons de BI statique (où vous regardez un graphique) pour BI Agentique (où un agent surveille les données et agit sur elles). Dans l’ancien monde, un Data Steward vérifiait manuellement les biais ou les erreurs de qualité. En 2026, les agents autonomes (sous surveillance humaine) fonctionnent comme des sentinelles silencieuses au sein de votre pile de données. Vous trouverez ci-dessous quelques cas d’utilisation déjà implémentables :

- Génération autonome de métadonnées : Les agents analysent les données nouvellement ingérées et les marquent automatiquement en fonction de leur sensibilité (RGPD), de leur provenance (AI Act) et de leur qualité. Ils « lisent » les données pour que les humains n’aient pas à le faire.

- Filtrage biaisé en temps réel : À mesure que les données circulent dans un modèle d’IA à haut risque, une couche agentique effectue une « vérification avant vol », signalant les lacunes représentatives ou les biais historiques avant qu’ils ne puissent influencer la formation d’un modèle.

- Pistes d’audit automatisées : Lorsqu’un régulateur demande des preuves de « surveillance humaine », un agent peut instantanément compiler un dossier de chaque décision prise, chaque journal capturé et chaque dérogation manuelle effectuée au cours des 12 derniers mois.

Vous pouvez automatiser les données, mais vous ne pouvez pas automatiser la responsabilité. En 2026, le rôle humain passe de l’exécution du travail à l’audit des agents qui effectuent le travail.

Confiance, réglementation et élément humain

Les organisations ne considèrent plus les réglementations comme un fardeau. Au lieu de cela, ils utilisent la conformité pour prouver la transparence et établir la confiance avec leurs clients, conseils d’administration et investisseurs. Alors que l’IA excelle en termes de rapidité, de reconnaissance de formes et de traitement de vastes données, la surveillance humaine est essentielle pour fournir le contexte, l’éthique, le raisonnement, l’empathie et la responsabilité. La loi sur l’IA interdit explicitement la prise de décision entièrement autonome en « boîte noire » pour les cas d’utilisation à haut risque (tels que le recrutement, la notation de crédit, les outils de diagnostic, etc.). Le « Human-in-the-Loop » est un élément architectural obligatoire. À tout moment, un humain devrait être capable de tuer ou d’annuler une décision de l’IA. Pour que cela soit efficace, les employés doivent être « familiarisés avec l’IA », c’est-à-dire qu’ils doivent comprendre comment repérer une « hallucination », comment protéger les données sensibles contre les fuites dans les LLM publics et comment utiliser les outils d’IA de manière responsable.

Un nouveau rôle émerge également en 2026 : Responsable de la conformité IA (AICO). Leur travail consiste à garantir que les systèmes d’IA respectent les normes juridiques, éthiques et réglementaires, atténuant ainsi les risques tels que les préjugés et les violations de la vie privée. Ces rôles ne sont plus « policiers » à la fin du processus ; ils participent à la phase de conception du produit, garantissant que « l’éthique dès la conception » est intégrée au code avant même que la première ligne ne soit écrite.

Conclusion

Au moment où le Loi européenne sur l’IA atteint ses étapes d’application complètes en août 2026, le fossé entre les « données matures » et les « données exposées » sera insurmontable. N’attendez pas que les auditeurs frappent à votre porte. Pour comprendre où en est votre organisation aujourd’hui, posez à votre équipe de direction ces quatre questions « dures » :

- Traçabilité : Si un régulateur demandait il y a trois mois les données de formation spécifiques utilisées pour votre modèle d’IA le plus critique, pourriez-vous produire une piste d’audit automatisée en moins d’une heure ?

- Résilience: Avez-vous un live Nomenclature logicielle (SBOM) qui identifie actuellement chaque composant open source touchant vos pipelines de données ?

- Souveraineté: Vos données résident-elles dans une pile où vous détenez les clés de chiffrement, ou votre conformité est-elle à la merci des conditions de service d’un hyperscaler non européen ?

- Alphabétisation : Votre personnel de première ligne sait-il comment identifier une « hallucination » de l’IA ou traite-t-il les résultats des agents comme une vérité absolue ?

Le moment est venu de pivoter. Commencez par unifier votre Métadonnées et l’établissement d’un Couche sémantique universelle. En simplifiant aujourd’hui votre architecture, vous construisez la « Forteresse Souveraine » qui vous permettra d’innover en toute confiance demain.

Avant de partir…

Suivez-moi pour ne manquer aucun nouveau message que j’écrirai à l’avenir ; vous trouverez plus de mes articles sur ma page de profil. Vous pouvez également me contacter sur LinkedIn ou X!