Introduction une variable continue pour quatre produits différents. Le pipeline d’apprentissage automatique a été construit dans Databricks et comporte deux composants principaux. Préparation des fonctionnalités en SQL avec calcul sans serveur. Inférence sur un ensemble de plusieurs centaines de modèles …

sur l’interprétabilité en IA, commencez par la mauvaise question. Les chercheurs, les praticiens et même les régulateurs se demandent souvent si un modèle est interprétable. Mais ce cadrage suppose que l’interprétabilité est une propriété qu’un modèle possède ou n’a pas. …

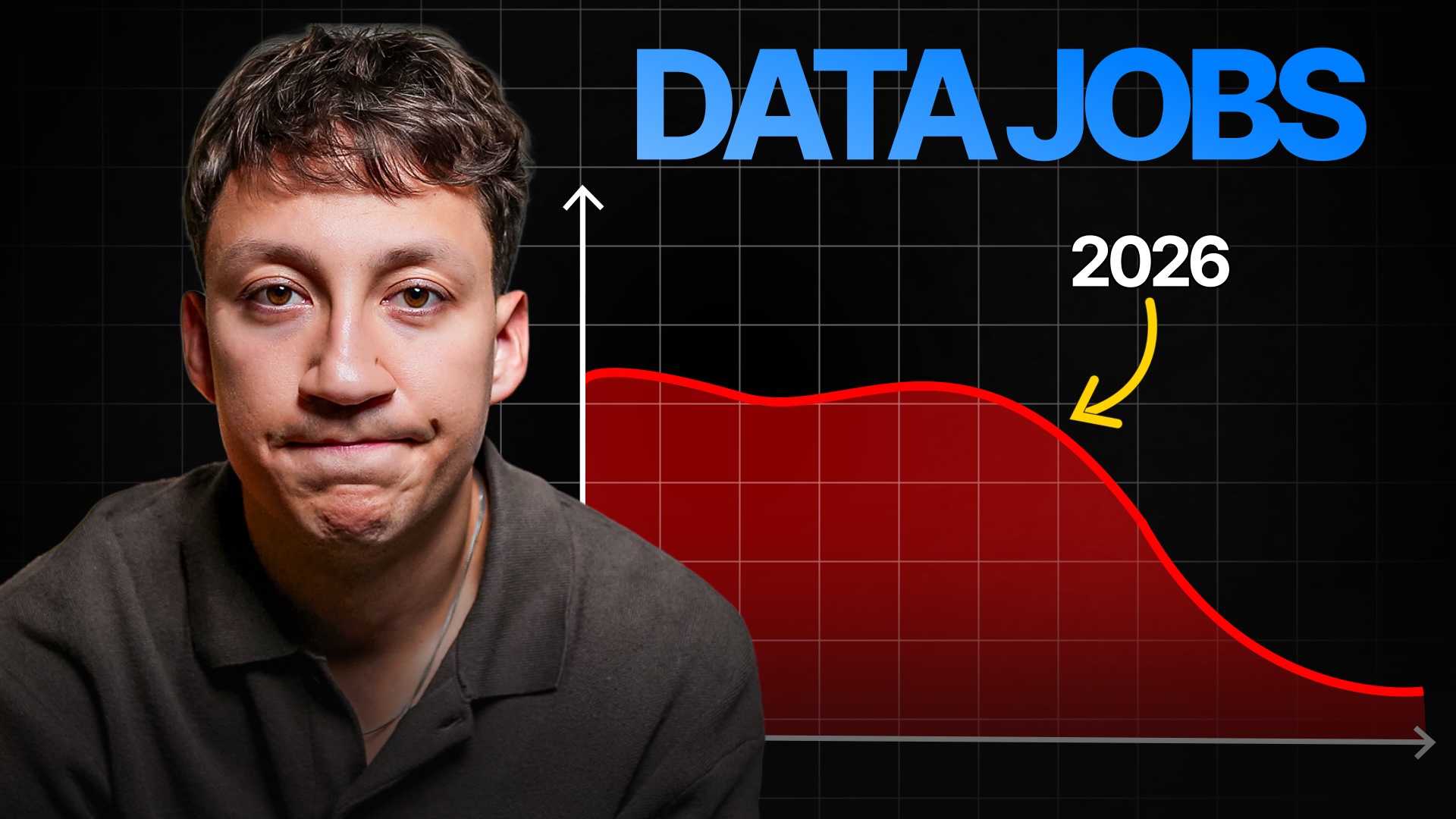

cinq minutes sur LinkedIn ou X, vous remarquerez un débat bruyant dans l’industrie de la science des données. Il est sorti depuis un moment maintenant, mais cette semaine, il a finalement retenu mon attention. Autant qu’on pourrait le penser, il …

Dans la série Author Spotlight, les rédacteurs de TDS discutent avec les membres de notre communauté de leur parcours professionnel en science des données et en IA, de leurs écrits et de leurs sources d’inspiration. Aujourd’hui, nous sommes ravis de …

Après avoir introduit les accélérateurs Gaudi dans les instances EC2 DL1 d’Amazon, nous avons été confrontés à un défi qui menaçait l’ensemble du déploiement. Les chiffres de performance n’étaient pas seulement décevants ; ils ont été désastreux. Les modèles qui …

traverse une profonde transformation portée par le progrès technologique. Ces changements touchent tous les secteurs, notamment le secteur bancaire. Les professionnels des données doivent s’adapter rapidement pour devenir plus efficaces, productifs et compétitifs. Pour les professionnels expérimentés possédant de solides …

fait partie d’une série sur l’IA distribuée sur plusieurs GPU : Introduction Le parallélisme des données distribuées (DDP) est la première méthode de parallélisation que nous examinerons. C’est l’approche de base qui est toujours utilisé dans les paramètres de formation distribuée, …

un réel problème lorsqu’il s’agit de très grands ensembles de données. Ce que j’entends par « très volumineux », ce sont les données qui dépassent la capacité de la RAM d’une seule machine. Certains des principaux points de friction auxquels …

la science des données était en train de mourir il y a 7 mois ? Il était également en train de mourir il y a 2 ans. Et je suis mort il y a 3 ans. Et sans oublier qu’il …

est incroyablement efficace pour créer rapidement de nouvelles applications. Ceci est, bien sûr, très utile pour toute tâche de programmation, qu’il s’agisse de travailler sur une application existante ou sur une nouvelle base de code. Cependant, d’après mon expérience personnelle, …