Comment un algorithme de quantification de 2021 surpasse discrètement son successeur de 2026

[3]une méthode de quantification vectorielle en ligne, a attiré l’attention du grand public lors de l’ICLR 2026. Pour moi, elle me semblait très familière : elle recoupe fortement avec EDENune méthode de quantification introduite pour la première fois sous le nom de méthode 1 bit CONDUIRE à NeurIPS 2021 [1] et généralisé à des largeurs de bits arbitraires à l’ICML 2022 [2]. Co-écrit par moi-même, avec Ran Ben-Basat, Yaniv Ben-Itzhak, Gal Mendelson, Michael Mitzenmacher et Shay Vargaftik.

L’article TurboQuant présente deux variantes : TurboQuant-mse et TurboQuant-prod. Dans une nouvelle comparaison détaillée [5] nous montrons que TurboQuant-mse est un cas dégénéré d’EDEN et que les variantes d’EDEN surpassent systématiquement leurs homologues.

Comment EDEN quantifie un vecteur

Supposons que vous deviez compresser un vecteur dimensionnel (une mise à jour de dégradé, une intégration, une entrée de cache KV) jusqu’à quelques bits par coordonnée. EDEN procède en quatre étapes :

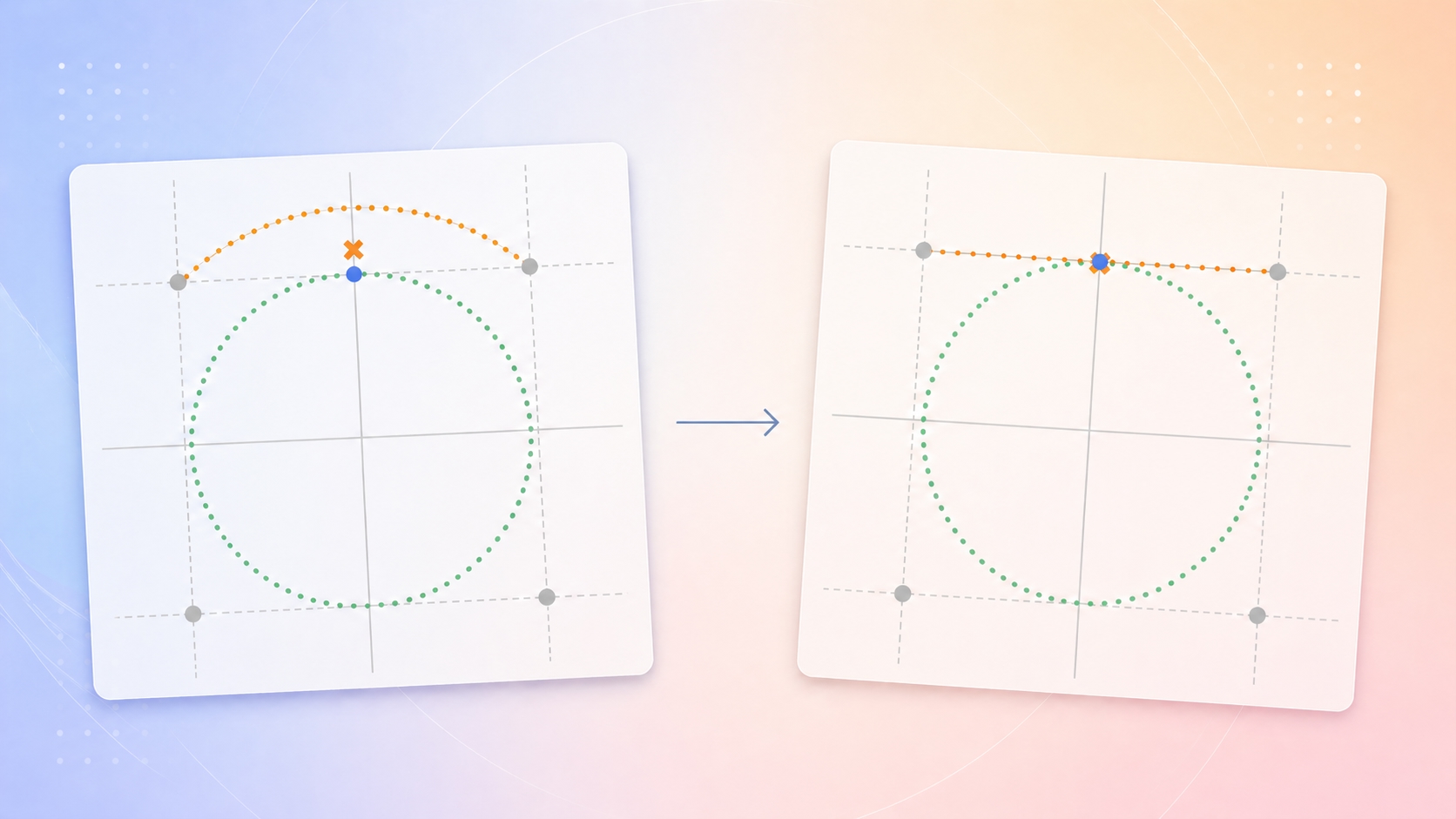

- Rotation aléatoire — Multiplier par une matrice orthogonale aléatoire . Après rotation, les coordonnées sont réparties de manière identique et, pour les grandes approximativement gaussien.

- Quantification scalaire — Arrondissez chaque coordonnée pivotée à l’une des niveaux à partir d’un livre de codes Lloyd-Max formé sur le connu distribution de coordonnées pivotée ( est le nombre cible de bits par coordonnée).

- Échelle — Multiplier par un facteur d’échelle .

- Rotation inverse – Appliquer récupérer une approximation du vecteur original.

Alors que des travaux antérieurs (par exemple Suresh et al. (2017) [6]) utilisait la rotation principalement pour réduire les coordonnées’ plage dynamique (l’écart entre la plus grande et la plus petite valeur de coordonnée), EDEN [1] était, à notre connaissance, le premier schéma de quantification à exploiter un fait plus fort concernant la rotation aléatoire : les coordonnées post-rotation suivent une distribution connue, ce qui nous permet d’utiliser une déterministe quantificateur associé à une échelle de forme fermée qui, selon l’application, minimise le MSE ou rend l’estimation impartiale. Les deux échelles sont dérivées analytiquement et la construction donne une réduction asymptotique de la MSE par rapport à l’approche précédente.

Concrètement, les deux variantes d’EDEN ne diffèrent que par le choix du :

- Biais EDEN — ensembles à la valeur de forme fermée qui minimise le MSE de reconstruction.

- EDEN-indépendant – choisit donc la sortie décompressée est correcte en moyenne (), ce qui est particulièrement important lorsque vous faites la moyenne de nombreux vecteurs quantifiés (par exemple, formation distribuée, attention).

Aligné contre EDEN, TurboQuant-mse correspond à chaque étape sauf une : où EDEN dérive l’échelle analytiquement, TurboQuant-mse, bien qu’il cible la minimisation du MSE, ignore la mise à l’échelle optimisée.

Le pseudocode ci-dessous montre les trois côte à côte.

Pourquoi l’échelle optimale en vaut la peine

L’intérêt d’appliquer une échelle appropriée grandit avec la largeur du bit. À peu, l’écart est marginal. À et bits, la polarisation EDEN réduit le MSE de 2,25 % par rapport à TurboQuant-mse, et ce sont les largeurs de bits que les praticiens utilisent réellement pour les intégrations et les caches KV.

Dans les dimensions 16 à 4096 et toutes les largeurs de bits testées vNMSE biaisé par EDEN (MSE normalisé par vecteur, ) tombe en dessous de TurboQuant-mse dans tous les cas (Figure 2). À mesure que la dimension devient très grande, la valeur optimale approche 1 et les deux algorithmes convergent, mais aux dimensions pratiques (128-1024), l’écart persiste.

Compression impartiale : économiser plus qu’un bit complet

Les résultats ci-dessus concernent les variantes biaisées (minimisant le MSE). Considérons maintenant le cas impartial, où des applications telles que la formation distribuée, l’attention approximative ou la récupération de produit interne nécessitent car ils font la moyenne de nombreux vecteurs quantifiés.

EDEN-impartial utilise le même algorithme à passage unique que EDEN-biased, juste avec choisi pour la correction du biais. La variante impartiale de TurboQuant, TurboQuant-prod, emprunte une voie différente : elle dépense bits sur l’étape TurboQuant-mse biaisée et réserve 1 bit pour un QJL (Quantized Johnson – Lindenstrauss) [4] correction sur le résidu (QJL est similaire à EDEN à mais avec une variance plus élevée).

EDEN-impartial surpasse TurboQuant-prod dans chaque configuration testée, et avec une marge substantielle. Cet écart s’explique par trois avantages structurels de la conception à passage unique d’EDEN :

- EDEN optimise l’échelle. TurboQuant-prod hérite de TurboQuant-mse première étape, elle entraîne donc la même pénalité MSE.

- La construction 1 bit d’EDEN a une variance inférieure à celle de QJL. En grande dimension, le vNMSE 1 bit d’EDEN converge vers [1]tandis que les QJL convergent vers [4]environ 2,75 × plus élevé.

- EDEN consacre la totalité de son budget de bits à un seul quantificateur impartial. TurboQuant-prod répartit le budget en bits biaisés plus 1 bit résiduel, ce qui sous-performe empiriquement en dépensant tous bits sur un seul quantificateur impartial [5].

Ces effets s’aggravent. Le résultat : Les formats EDEN non biaisés 1 bit, 2 bits et 3 bits sont chacun plus précis que les TurboQuant-prod 2 bits, 3 bits et 4 bits, respectivement. (Figure 3). En échangeant dans EDEN, vous pouvez perdre un peu par coordonnée tout en respectant la précision de TurboQuant-prod.

Sur les propres benchmarks de TurboQuant

La même image s’applique aux critères de référence ANN standard sur lesquels TurboQuant évalue, l’étude de Stanford Vecteurs de mots pré-entraînés GloVe (Open Data Commons Dédicace et licence du domaine public v1.0) et Qdrant dbpedia-entities-openai3-text-embedding-3-large intégrations (Apache 2.0), en utilisant le code d’évaluation publié par TurboQuant :

Le biais EDEN atteint un MSE inférieur à celui de TurboQuant-mse, le biais EDEN atteint une erreur de produit interne nettement inférieure à celle de TurboQuant-prod, et le rappel du voisin le plus proche sur les deux ensembles de données favorise EDEN (Figure 4).

À retenir : utilisez EDEN ; une mise à l’échelle optimale est importante

L’échelle d’EDEN relie la distribution post-rotation connue à un quantificateur analytiquement optimal. TurboQuant-mse conserve la rotation d’EDEN et le livre de codes mais les épingles ce qui en fait un cas particulier strictement plus faible. TurboQuant-prod ajoute en plus une étape QJL 1 bit, où EDEN-impartial obtient la même propriété, avec une meilleure précision, en choisissant simplement une échelle de correction de biais.

- Pour une compression ciblée sur MSE (quantification du poids du modèle, recherche du voisin le plus proche, cache KV) : EDEN-biaisé calcule l’échelle optimale et bat systématiquement TurboQuant-mse (qui est ÉDEN avec fixé).

- Pour une estimation impartiale (estimation de la moyenne distribuée, attention approximative, récupération du produit interne) : EDEN-impartial surpasse considérablement la stratégie de fractionnement de bits de TurboQuant-prod, avec des marges valant plus d’un bit complet par coordonnée.

EDEN a été initialement développé pour l’estimation de moyenne distribuée dans les formations fédérées et distribuées. Des travaux ultérieurs l’ont, par exemple, appliqué à la compression intégrée pour le reclassement des documents (DTS2022 [8]), l’a adapté pour la formation NVFP4 LLM (MS-EDEN dans Quatuor II2026 [10]), l’a généralisé à la quantification vectorielle pour la compression de poids LLM sans données (HIGGS2025 [9]), qui a ensuite été utilisé pour la compression du cache KV (AQUA-KV2025 [11]).

Les implémentations EDEN sont disponibles : en PyTorch et TensorFlowdans OpenFL d’Intel [7]et sa variante 1 bit dans Google FedJax, TensorFlow fédéréet Optimisation du modèle TensorFlow.

Pour l’analyse comparative technique complète avec TurboQuant (tous les chiffres, méthodologie expérimentale détaillée), voir notre note [5].

Pour les dérivations originales, les preuves et les extensions supplémentaires, consultez nos articles originaux [1] [2].

Références

- S. Vargaftik, R. Ben-Basat, A. Portnoy, G. Mendelson, Y. Ben-Itzhak, M. Mitzenmacher, DRIVE : estimation de la moyenne distribuée sur un bit (2021), NeurIPS 2021.

- S. Vargaftik, R. Ben-Basat, A. Portnoy, G. Mendelson, Y. Ben-Itzhak, M. Mitzenmacher, EDEN : estimation moyenne distribuée, efficace et robuste en matière de communication pour l’apprentissage fédéré (2022), ICML 2022.

- A. Zandieh, M. Daliri, A. Hadian, V. Mirrokni, TurboQuant : quantification vectorielle en ligne avec un taux de distorsion quasi optimal (2026), ICLR 2026.

- A. Zandieh, M. Daliri, I. Han, QJL : transformation JL quantifiée sur 1 bit pour la quantification du cache KV sans surcharge (2024), arXiv :2406.03482.

- R. Ben-Basat, Y. Ben-Itzhak, G. Mendelson, M. Mitzenmacher, A. Portnoy, S. Vargaftik, Une note sur TurboQuant et la ligne de travail antérieure de DRIVE/EDEN (2026), arXiv :2604.18555.

- AT Suresh, FX Yu, S. Kumar, HB McMahan, Estimation moyenne distribuée avec communication limitée (2017), ICML 2017.

- Blog VMware Open Source, EDEN de VMware Research Group fait partie d’OpenFL (novembre 2022).

- N. Cohen, A. Portnoy, B. Fetahu, A. Ingber, SDR : reclassement neuronal efficace à l’aide d’une représentation succincte de documents (2022), ACL 2022.

- V. Malinovskii, A. Panferov, I. Ilin, H. Guo, P. Richtárik, D. Alistarh, HIGGS : repousser les limites de la quantification des grands modèles de langage via le théorème de linéarité (2025), NAACL 2025.

- A. Panferov, E. Schultheis, S. Tabesh, D. Alistarh, Quartet II : Pré-formation LLM précise en NVFP4 grâce à une estimation améliorée du gradient impartial (2026), arXiv : 2601.22813.

- A. Shutova, V. Malinovskii, V. Egiazarian, D. Kuznedelev, D. Mazur, N. Surkov, I. Ermakov, D. Alistarh, Cachez-moi si vous le devez : quantification adaptative des valeurs-clés pour les grands modèles de langage (2025), ICML 2025.