Une méthode géométrique pour repérer les hallucinations sans juge LLM

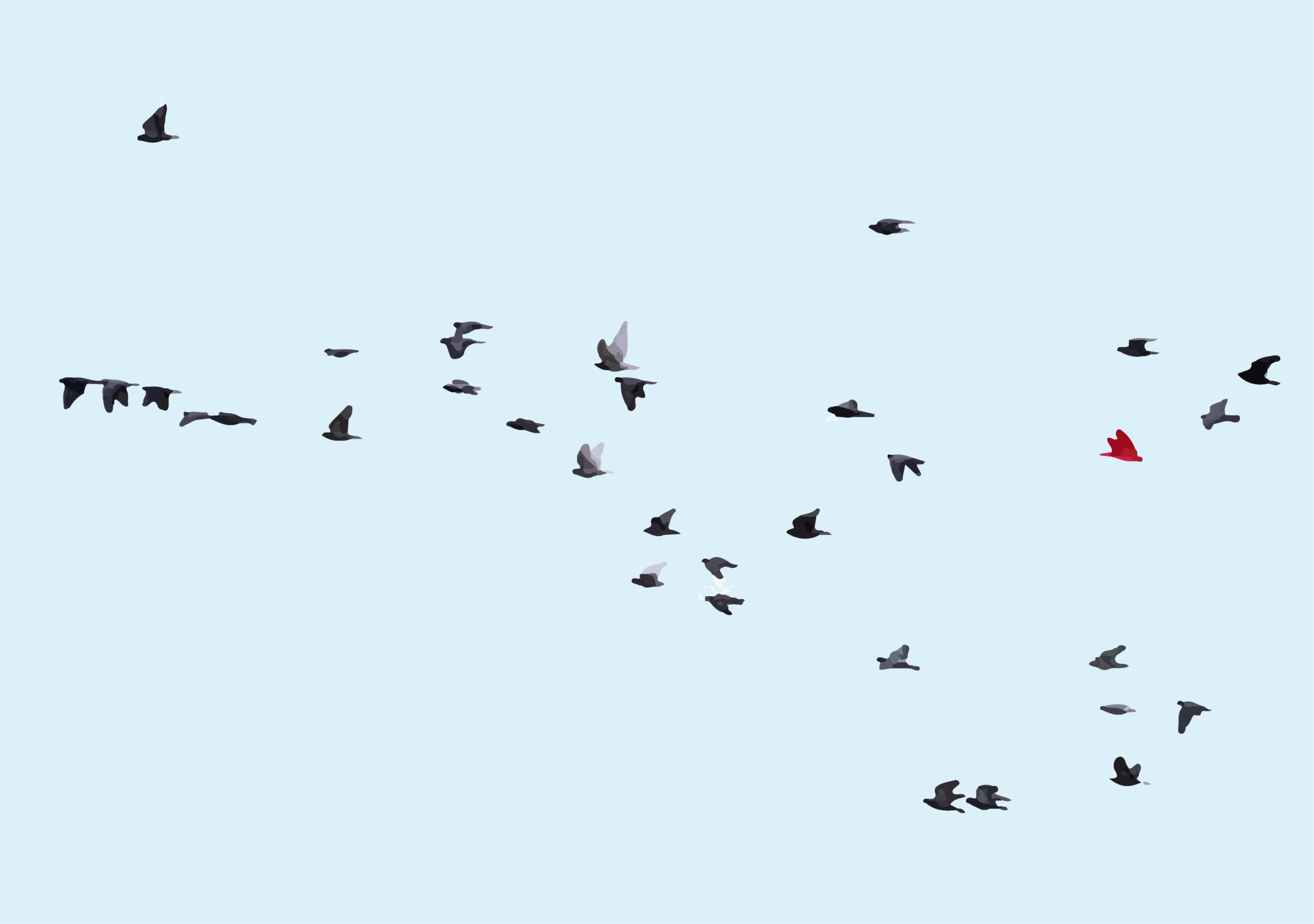

d’oiseaux en vol.

Il n’y a pas de chef. Pas de commandement central. Chaque oiseau s’aligne sur ses voisins – en faisant correspondre la direction, en ajustant la vitesse, en maintenant la cohérence grâce à une coordination purement locale. Le résultat est un ordre mondial émergeant d’une cohérence locale.

Imaginez maintenant un oiseau volant avec la même conviction que les autres. Ses battements d’ailes sont confiants. Sa vitesse est correcte. Mais sa direction ne correspond pas à celle de ses voisins. C’est l’oiseau rouge.

Ce n’est pas perdu. Ce n’est pas hésiter. Cela n’appartient tout simplement pas au troupeau.

Les hallucinations dans les LLM sont des oiseaux rouges.

Le problème que nous essayons réellement de résoudre

Les LLM génèrent un texte fluide et confiant pouvant contenir des informations fabriquées. Ils inventent des cas juridiques qui n’existent pas. Ils citent des articles qui n’ont jamais été rédigés. Ils exposent les faits avec le même ton, que ces faits soient vrais ou complètement inventés.

L’approche standard pour détecter cela consiste à demander à un autre modèle de langage de vérifier la sortie. LLM-en tant que juge. Le problème est immédiatement visible : nous utilisons un système qui hallucine pour détecter les hallucinations. C’est comme demander à quelqu’un qui ne sait pas distinguer les couleurs de trier des échantillons de peinture. Ils vous donneront une réponse. Cela pourrait même être vrai parfois. Mais ils ne voient pas réellement ce que vous avez besoin qu’ils voient.

La question que nous avons posée était différente : peut-on détecter des hallucinations à partir de la structure géométrique du texte lui-même, sans avoir besoin de l’avis d’un autre modèle de langage ?

Que font réellement les intégrations

Avant d’aborder la méthode de détection, je souhaite prendre du recul et établir avec quoi nous travaillons.

Lorsque vous introduisez du texte dans un encodeur de phrase, vous récupérez un vecteur, un point dans un espace de grande dimension. Les textes sémantiquement similaires se rapprochent les uns des autres. Des textes qui n’ont aucun rapport et qui sont très éloignés les uns des autres. C’est pour cela que l’entraînement contrastif est optimisé. Mais il existe une structure plus subtile que simplement « des choses similaires sont proches ».

Considérez ce qui se passe lorsque vous intégrez une question et sa réponse. La question se pose quelque part dans cet espace d’intégration. La réponse atterrit ailleurs. Le vecteur qui les relie – ce que nous appelons le déplacement-pointe dans une direction particulière. Nous avons un vecteur : une grandeur et un angle.

Nous avons également observé que pour les réponses ancrées dans un domaine spécifique, ces vecteurs de déplacement pointent dans des directions cohérentes. Nous avons trouvé quelque chose en commun : les angles.

Si vous posez cinq questions similaires et obtenez cinq réponses fondées, les déplacements d’une question à l’autre seront à peu près parallèles. Pas identique – les magnitudes varient, les angles exacts diffèrent légèrement – mais la direction générale est cohérente.

Lorsqu’un mannequin hallucine, quelque chose de différent se produit. La réponse arrive toujours quelque part dans l’espace d’intégration. C’est toujours fluide. Cela ressemble toujours à une réponse. Mais le déplacement ne suit pas le modèle local. Cela pointe ailleurs. Un vecteur avec un angle totalement différent.

L’oiseau rouge vole avec confiance. Mais pas avec le troupeau. Vole dans la direction opposée avec un angle totalement différent du reste des oiseaux.

Cohérence du déplacement (DC)

Nous formalisons cela sous le nom de cohérence de déplacement (DC). L’idée est simple :

- Créez un ensemble de référence de paires questions-réponses fondées à partir de votre domaine

- Pour une nouvelle paire question-réponse, retrouver les questions voisines dans l’ensemble de référence

- Calculer la direction de déplacement moyenne de ces voisins

- Mesurez dans quelle mesure le nouveau déplacement s’aligne avec cette direction moyenne

Les réponses fondées s’alignent bien. Ce n’est pas le cas des réponses hallucinées. C’est ça. Une similarité cosinus. Aucun document source n’est nécessaire au moment de l’inférence. Pas de plusieurs générations. Aucun élément interne du modèle.

Et cela fonctionne remarquablement bien. À travers cinq modèles d’intégration architecturalement distincts, sur plusieurs tests d’hallucination, notamment HaluEval et TruthfulQA, DC atteint une discrimination presque parfaite. Les distributions se chevauchent à peine.

Le piège : la localité du domaine

Nous avons testé DC sur cinq modèles d’intégration choisis pour couvrir la diversité architecturale : réglage fin contrastif basé sur MPNet (all-mpnet-base-v2), pré-formation faiblement supervisée (E5-large-v2), formation adaptée aux instructions avec des négatifs durs (BGE-large-en-v1.5), adaptation encodeur-décodeur (GTR-T5-large) et architectures efficaces à contexte long (nomic-embed-text-v1.5). Si DC ne fonctionnait qu’avec une seule architecture, il pourrait s’agir d’un artefact de ce modèle spécifique. Des résultats cohérents sur des modèles architecturaux distincts suggèrent que la structure est fondamentale.

Les résultats étaient cohérents. DC a atteint un AUROC de 1,0 sur les cinq modèles de notre référence synthétique. Mais les benchmarks synthétiques peuvent être trompeurs : peut-être que les réponses remaniées par domaines sont tout simplement trop faciles à détecter.

Nous avons donc validé des ensembles de données sur les hallucinations établis : HaluEval-QA, qui contient des hallucinations générées par LLM spécifiquement conçues pour être subtiles ; HaluEval-Dialogue, avec des réponses qui s’écartent du contexte de la conversation ; et TruthfulQA, qui teste les idées fausses courantes auxquelles les humains croient fréquemment.

DC a maintenu une discrimination parfaite sur chacun d’eux. Zéro dégradation des références synthétiques aux références réalistes.

À titre de comparaison, les méthodes basées sur des ratios qui mesurent où les réponses arrivent par rapport aux requêtes (plutôt que la direction dans laquelle elles se déplacent) ont atteint un AUROC d’environ 0,70 à 0,81. L’écart (environ 0,20 AUROC absolu) est important et cohérent dans tous les modèles testés.

Les répartitions des partitions racontent l’histoire visuellement. Les réponses fondées se regroupent étroitement à des valeurs DC élevées (environ 0,9). Les réponses hallucinées se propagent à des valeurs inférieures (environ 0,3). Les distributions se chevauchent à peine.

DC réalise une détection parfaite dans un domaine étroit. Mais si vous essayez d’utiliser un ensemble de référence d’un domaine pour détecter des hallucinations dans un autre domaine, les performances chutent à un niveau aléatoire : AUROC autour de 0,50. Cela nous apprend quelque chose de fondamental sur la façon dont les intégrations codent la mise à la terre. Cela équivaut à voir différents troupeaux dans le ciel : chaque troupeau aura une direction différente.

Pour les LLM, le moyen le plus simple de comprendre cela est d’utiliser l’image de ce qu’on appelle en géométrie un « faisceau de fibres ».

La surface de la figure 1 est la variété de base représentant toutes les questions possibles. En chaque point de cette surface se trouve une fibre : une ligne pointant dans la direction dans laquelle se déplacent les réponses ancrées. Dans n’importe quelle région locale de la surface (un domaine spécifique), toutes les fibres pointent à peu près de la même manière. C’est pourquoi DC fonctionne si bien au niveau local.

Mais à l’échelle mondiale, dans différentes régions, les fibres pointent dans des directions différentes. La « direction fondée » pour les questions juridiques est différente de la « direction fondée » pour les questions médicales. Il n’existe pas de modèle mondial unique. Seulement une cohérence locale.

Regardez maintenant la vidéo suivante. Trajectoires de vol des oiseaux reliant l’Europe et l’Afrique. Nous pouvons voir les faisceaux de fibres. Différents oiseaux (moyens/grands, petits, insectes) ont des directions différentes.

En géométrie différentielle, cette structure est appelée trivialité locale sans trivialité globale. Chaque patch du collecteur semble simple et cohérent en interne. Mais les patchs ne peuvent pas être assemblés dans un seul système de coordonnées global.

Cela a une implication notable :

la mise à la terre n’est pas une propriété géométrique universelle

Il n’y a pas de « direction de véracité » unique dans l’espace d’intégration. Chaque domaine – chaque type de tâche, chaque LLM – développe son propre modèle de déplacement au cours de la formation. Les modèles sont réels et détectables, mais ils sont spécifiques à un domaine. Les oiseaux ne migrent pas dans la même direction.

Ce que cela signifie concrètement

Pour le déploiement, la recherche de domaine-localité signifie que vous avez besoin d’un petit ensemble d’étalonnage (environ 100 exemples) adapté à votre cas d’utilisation spécifique. Un système de questions et réponses juridiques a besoin d’exemples juridiques. Un chatbot médical a besoin d’exemples médicaux. Il s’agit d’un coût initial unique (l’étalonnage s’effectue hors ligne), mais il ne peut être ignoré.

Pour comprendre les intégrations, les résultats suggèrent que ces modèles codent une structure plus riche que ce que nous supposons généralement. Ils n’apprennent pas seulement la « similarité ». Ils apprennent des cartographies spécifiques à un domaine dont la perturbation signale de manière fiable une hallucination.

L’oiseau rouge ne le fait pas

La réponse hallucinée n’a aucun marqueur indiquant « Je suis fabriqué ». C’est fluide. C’est confiant. Cela ressemble exactement à une réponse fondée sur chaque métrique au niveau de la surface.

Mais il ne bouge pas avec le troupeau. Et maintenant, nous pouvons le mesurer.

La géométrie a toujours été présente, implicite dans la manière dont la formation contrastée façonne l’intégration de l’espace. Nous apprenons juste à le lire.

Remarques :

Vous pouvez trouver l’article complet sur https://cert-framework.com/docs/research/dc-paper.

Si vous avez des questions sur les sujets abordés, n’hésitez pas à me contacter au [email protected]