Bonferroni vs Benjamini-Hochberg : choisir votre correction de valeur P

être un sujet sensible. Il vaut peut-être mieux l’éviter lors de la première rencontre avec un statisticien. La disposition à l’égard du sujet a conduit à un accord tacite qui α = 0,05 est l’étalon-or – en vérité, une « convention pratique », une règle empirique établie par Ronald Fisher lui-même.

OMS?? Vous ne le connaissez pas ? Ne t’inquiète pas.

Il a été le premier à introduire l’estimation du maximum de vraisemblance (MLE), l’ANOVA et l’information de Fisher (cette dernière, vous l’avez peut-être deviné). Fisher était plus qu’une figure importante de la communauté, le père des statistiques. Avait un profond intérêt pour la génétique mendélienne et la biologie évolutive, pour lesquelles il apporterait plusieurs contributions clés. Malheureusement, Fisher a aussi eu un passé épineux. Il était impliqué dans la Société Eugénique et sa politique de stérilisation volontaire pour les « faibles d’esprit ».

Oui, il n’existe pas de statisticien célèbre.

Mais une règle empirique établie par le père de la statistique peut parfois être confondue avec une loi, et ce n’est pas le cas.

Il existe un cas clé où vous êtes non seulement obligé de le faire, mais doit changer ce niveau alpha, et tout se résume à tests d’hypothèses multiples.

Pour exécuter plusieurs tests sans utiliser le Bonferroni Correction ou le Benjamini-Hochberg la procédure est plus que problématique. Sans ces corrections, nous pourrions prouver n’importe quelle hypothèse :

H₁ : Le soleil est bleu

En réexécutant simplement notre expérience jusqu’à ce que la chance nous vienne. Mais comment fonctionnent ces corrections ? et lequel devriez-vous utiliser ? Ils ne sont pas interchangeables !

Les valeurs P et un problème

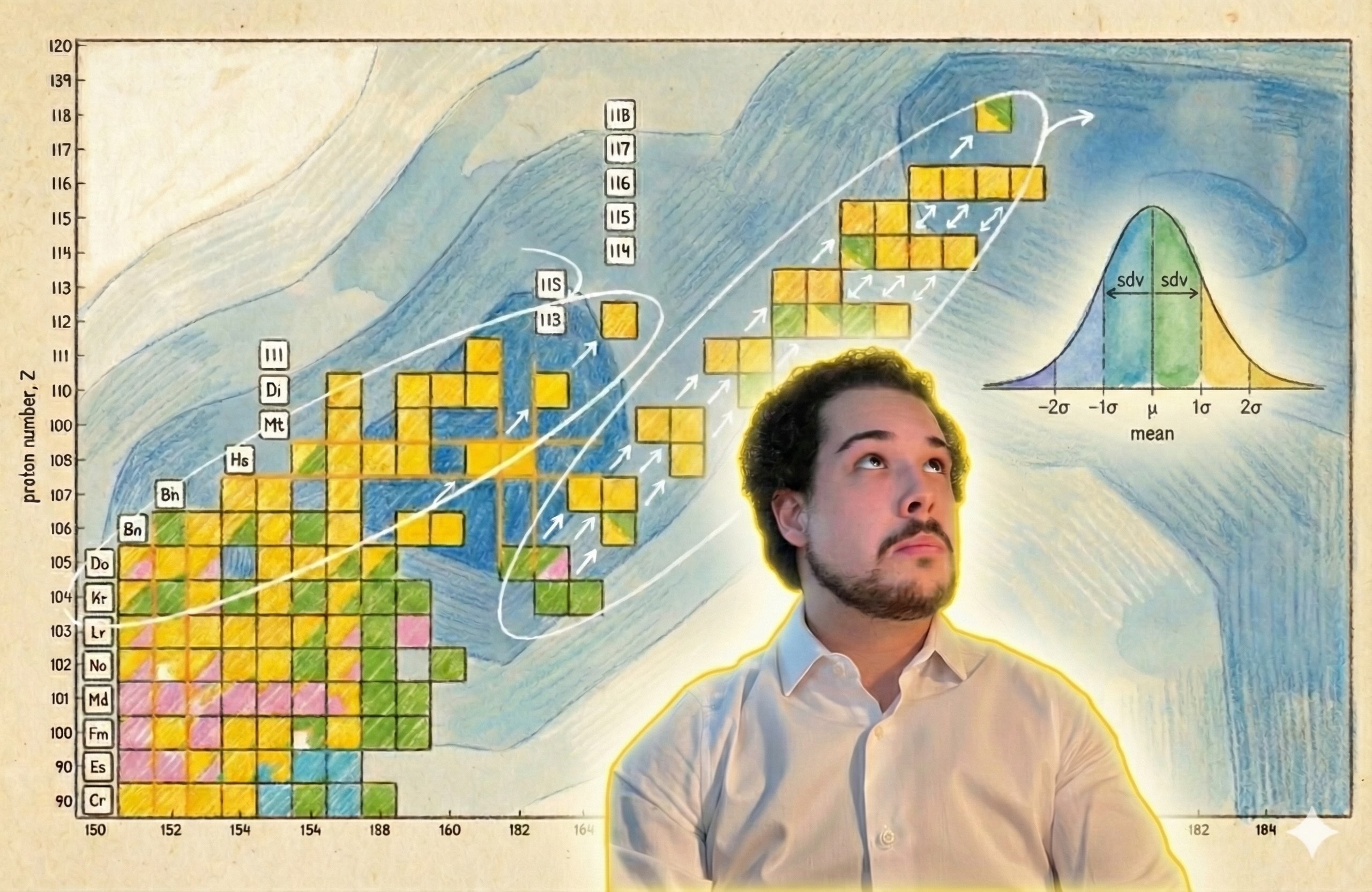

Pour comprendre pourquoi, nous devons examiner ce que nous dit exactement notre valeur p. Le comprendre plus profondément que ce qui est petit est une bonne chose et que ce qui est grand est un mal. Mais pour ce faire, nous aurons besoin d’une expérience, et rien n’est aussi excitant – ni aussi contesté – que la découverte d’éléments super-lourds.

Ces éléments sont incroyablement instable et créé dans des accélérateurs de particules, un atome à la fois. Livre pour livre, c’est la chose la plus chère jamais produite. N’existant que lors d’événements cosmiques comme les supernovae, ne durant que millièmes ou millionièmes d’une seconde.

Mais leur instabilité devient un avantage pour la détection, car un nouvel élément super-lourd présenterait une désintégration radioactive distincte. La séquence de désintégration capturée par les capteurs du réacteur peut nous indiquer si un nouvel élément est présent.

Comme hypothèse nulle, nous affirmons :

H₀ = La séquence est la décroissance du bruit de fond. (Aucun nouvel élément)

Nous devons maintenant rassembler des preuves que H₀ est pas vrai si nous voulons prouver que nous avons créé un nouvel élément. Cela se fait grâce à nos statistiques de test T(X). De manière générale, cela reflète la différence entre ce que les capteurs observent et ce que l’on attend du rayonnement de fond. Tous les statistiques de test sont une mesure de la « surprise » entre ce que nous nous attendons à observer si H₀ est vrai et ce que disent réellement nos échantillons de données. Le plus grand T(X)plus nous avons de preuves que H₀ est faux.

C’est précisément ce que Statistique du test de Schmidt fait sur la séquence des temps de désintégration radioactive.

\[

\sigma_{obs} = \sqrt{\frac{1}{n-1} \sum_{i=1}^{n} (\ln t_i – \overline{\ln t})^2}

\]

La statistique du test de Schmidt a été utilisée pour découvrir : Hassium (108), Meitnérium (109) dans 1984 Darmstadtium (110), élément 111 Roentgénium (111), Copernicium (112) de 1994 à 1996 Moscovie (115), Tennessine (117). depuis 2003 à 2016

Il est essentiel de spécifier une distribution pour H₀ afin que nous puissions calculer la probabilité qu’une statistique de test soit aussi extrême que la statistique de test des données observées.

Nous supposons que les désintégrations du bruit suivent un distribution exponentielle. Il y a un million de raisons pour lesquelles c’est une bonne hypothèse, mais ne nous enlisons pas ici. Si nous n’avons pas de distribution pour H₀, calculer notre valeur de probabilité serait impossible !

\[

H_0^{(Schmidt)}:t_1,…,t_n i.i.d. ∼ Exp(λ)

\]

La valeur p est alors la probabilité, sous le modèle nul, d’obtenir une statistique de test au moins aussi extrême que celle calculée à partir des données de l’échantillon. Moins notre statistique de test est probable, plus il est probable que H₀ soit faux.

\[

p \;=\; \Pr_{H_0}\!\big( T(X) \ge T(x_{\mathrm{obs}}) \big).

\]

Bien entendu, cela soulève une question intéressante. Et si nous observions un taux de désintégration rare, un taux de désintégration qui ressemble simplement à celui d’une particule en décomposition non découverte ? Et si nos capteurs détectaient une séquence de désintégration improbable, bien que possible, qui donne lieu à une statistique de test importante ? Chaque fois que nous exécutons le test, il y a une petite chance d’obtenir une valeur aberrante simplement par hasard. Cette valeur aberrante donnera une statistique de test importante car elle sera très différente de ce que nous nous attendons à voir lorsque H₀ est vrai. Le grand T(x) sera dans les queues de notre distribution attendue de H₀ et produira une petite valeur p. Une faible probabilité d’observer quelque chose de plus extrême que cette valeur aberrante. Mais aucun élément nouveau n’existe ! nous venons d’obtenir 31 rouges en jouant à la roulette un million de fois.

Cela semble peu probable, mais si l’on garde à l’esprit que les protons sont envoyés vers des particules cibles pendant mois à la foisla possibilité existe. Alors comment en rendre compte ?

Il existe deux méthodes : une méthode conservatrice et une méthode moins conservatrice. Votre choix dépend de l’expérience. Nous pouvons utiliser le :

- Taux d’erreur Family Wise (FWER) et correction de Bonferroni

- Taux de fausses découvertes (FDR) et procédure Benjamini-Hochberg

Ceux-ci ne sont pas interchangeables ! Vous devez examiner attentivement votre étude et choisir la bonne.

Si la physique vous intéresse :

De nouveaux éléments sont créés en accélérant des ions plus légers à 10 % de la vitesse de la lumière. Ces faisceaux d’ions bombardent des atomes cibles plus lourds. Des vitesses incroyables et une énergie cinétique sont nécessaires pour surmonter la barrière coulombienne (l’immense force répulsive entre deux particules chargées positivement).

| Nouvel élément | Faisceau (Protons) | Cible (Protons) |

| Nihonium (113) | Zinc-70 (30) | Bismuth-209 (83) |

| Moscovie (115) | Calcium-48 (20) | Américium-243 (95) |

| Tennessine (117) | Calcium-48 (20) | Berkélium-249 (97) |

| Oganesson (118) | Calcium-48 (20) | Californie-249 (98) |

Taux d’erreur familial (Bonferroni)

Il s’agit de notre approche conservatrice et de ce qui devrait être utilisé si nous ne pouvons admettre aucun faux positif. Cette approche conserve la probabilité d’admettre au moins un Erreur de type I en dessous de notre niveau alpha.

\[

\Pr(\text{at least one Type I error in the family}) \leq \alpha

\]

Il s’agit également d’une correction plus simple. Divisez simplement le niveau alpha par le nombre de fois que l’expérience a été exécutée. Ainsi, pour chaque test, vous rejetez l’hypothèse nulle si et seulement si :

\[

p_i \leq \frac{\alpha}{m}

\]

De manière équivalente, vous pouvez ajuster vos valeurs p. Si tu cours m tests, passez :

\[

p_i^{\text{adj}} = \min(1, m p_i)

\]

Et rejetez l’hypothèse nulle si :

\[

p_i^{(\text{Bonf})} \le \alpha

\]

Tout ce que nous avons fait ici, c’est multiplier les deux côtés de l’inégalité par m.

La preuve en est également une mince ligne. Si nous laissons Aᵢ être l’événement où il y a un faux positif dans le test i. Alors la probabilité d’avoir au moins un faux positif sera la probabilité de l’union de tous ces événements.

\[

\text{Pr}(\text{at least one false positive}) = \text{Pr}\left(\bigcup_{i=1}^{m} A_i\right) \le \sum_{i=1}^{m} \text{Pr}(A_i) \le m \cdot \frac{\alpha}{m} = \alpha

\]

Ici, nous utilisons le syndicat lié. un concept fondamental de probabilité qui énonce la probabilité que A₁, ou A₂, ou Aₖ se produise doit être inférieure ou égale à la somme des probabilités que chaque événement se produise.

\[

\text{Pr}(A_1 \cup A_2 \cup \cdots \cup A_k) \le \sum_{i=1}^{k} \text{Pr}(A_i)

\]

Taux de fausses découvertes (Benjamini-Hochberg)

La procédure Benjamini-Hochberg n’est pas non plus trop compliquée. Simplement:

- Triez vos valeurs p : p₁ ≤ … ≤ pₘ.

- Acceptez le premier k où pₖ > α/(m−k+1)

Dans cette approche, l’objectif est de contrôler le taux de fausses découvertes (FDR).

\[

\text{FDR} = E\left[ \frac{V}{\max(R, 1)} \right]

\]

Où R. est le nombre de fois où nous rejetons l’hypothèse nulle, et V est le nombre de rejets qui sont (malheureusement) des faux positifs (erreurs de type I). L’objectif est de maintenir cette métrique en dessous d’un seuil spécifique q = 0,05.

Les seuils BH sont :

\[

\frac{1}{m}q, \frac{2}{m}q, \dots, \frac{m}{m}q = q

\]

Et nous rejetons les premières plus petites valeurs p où :

\[

P_{(k)} \leq \frac{k}{m}q

\]

Utilisez-le lorsque vous acceptez certains faux positifs. Lorsque votre principale préoccupation est de minimiser taux d’erreur de type IIc’est-à-dire que vous voulez vous assurer qu’il y a moins de faux négatifs, aucun cas où nous acceptons H₀ alors que H₀ est en fait faux.

Considérez cela comme une étude génomique dans laquelle vous visez à identifier toutes les personnes possédant un gène spécifique qui les rend plus susceptibles à un cancer particulier. Il serait moins dangereux de traiter certaines personnes qui ne portaient pas le gène que de risquer de laisser quelqu’un qui l’a eu s’en sortir sans traitement.

Côte à côte rapide

Bonferroni:

- Contrôle le taux d’erreur par famille (FWER).

- Garantit la probabilité d’une seule fausse découverte taux ≤ α

- Taux de faux négatifs plus élevé ⇒ Puissance statistique plus faible

- Tolérance au risque zéro

Benjamini-Hochberg

- Contrôle le taux de fausses découvertes (FDR)

- garantit que parmi toutes les découvertes, les faux positifs sont ≤ q

- Moins de faux négatifs ⇒ Puissance statistique plus élevée

- Une certaine tolérance au risque

Un super petit p pour un atome super lourd

Nous ne pouvons pas avoir d’éléments inexistants dans le tableau périodique, donc lorsqu’il s’agit de trouver un nouvel élément, la correction de Bonferroni est la bonne approche. Mais lorsqu’il s’agit de données sur la chaîne de désintégration collectées par des détecteurs au silicium sensibles à la position, choisir un m ce n’est pas si simple.

Les physiciens ont tendance à utiliser le nombre attendu de chaînes aléatoires produites par l’ensemble de la recherche sur l’ensemble des données :

\[

\Pr(\ge 1 \text{ random chain}) \approx 1 – e^{-n_b}

\]

\[

1 – e^{-n_b} \leq \alpha_{\text{family}} \Rightarrow n_b \approx \alpha_{\text{family}} \quad (\text{approximately, for rare events})

\]

Le nombre de chaînes aléatoires provient de l’observation des données de base lorsqu’aucune expérience n’a lieu. à partir de ces données, nous pouvons construire la distribution nulle H₀ grâce à la simulation de Monte Carlo

Nous estimons le nombre de chaînes aléatoires en modélisant les taux d’événements de fond et en rééchantillonnant les événements de fond observés. Sous H₀ (pas de chaîne de désintégration d’éléments lourds), nous utilisons Monte Carlo pour simuler de nombreuses réalisations nulles et calculer la fréquence à laquelle l’algorithme de recherche produit une chaîne aussi extrême que la chaîne observée.

Plus précisément :

H₀ : les événements de fond arrivent sous la forme d’un processus de Poisson avec un taux λ ⇒ les temps entre arrivées sont exponentiels.

Alors une chaîne accidentelle est constituée de k coups consécutifs en τ temps. Nous analysons les données à l’aide de nos statistiques de test pour déterminer s’il existe un cluster extrême.

lambda_rate = 0.2 # events per second

T_total = 2_000.0 # seconds of data-taking (mean events ~ 400)

k = 4 # chain length

tau_obs = 0.20 # "observed extreme": 4 events within 0.10 sec

Nmc = 20_000

rng = np.random.default_rng(0)

def dmin_and_count(times, k, tau):

if times.size < k:

return np.inf, 0

spans = times[k-1:] - times[:-(k-1)]

return float(np.min(spans)), int(np.sum(spans <= tau))

...Simulation Monte-Carlo sur GitHub

Si les chiffres vous intéressent, à la découverte de l’élément 117 Tennessine (Ts), une valeur p de 5×10−16 a été utilisé. J’imagine que si aucune correction n’était jamais utilisée, notre tableau périodique ne serait malheureusement pas de la taille d’une affiche et la chimie serait en ruine.

Conclusion

Tout ce concept consistant à rechercher quelque chose dans de nombreux endroits, puis à traiter un incident particulièrement significatif comme s’il provenait d’une seule observation, est communément appelé le Effet regarder ailleurs. et il existe deux manières principales de nous adapter à cela :

- Bonferroni Correction

- Benjamini-Hochberg Procédure

Notre choix dépend entièrement de notre degré de prudence.

Mais même avec une valeur p de 5×10−16vous vous demandez peut-être quand une valeur p de 10 ^ -99 doit encore être ignorée. Et tout cela revient à Victor Ninov, physicien au Lawrence Berkeley National Laboratory. Qui fut – pendant un bref instant – l’homme qui a découvert l’élément 118.

Cependant, une enquête interne a révélé qu’il avait fabriqué la chaîne de désintégration alpha. Dans ce cas, en ce qui concerne les fautes professionnelles en recherche et les données falsifiées, même une valeur p de 10^-99 ne justifie pas le rejet de l’hypothèse nulle.

Références

Bodmer, W., Bailey, RA, Charlesworth, B., Eyre-Walker, A., Farewell, V., Mead, A. et Senn, S. (2021). Le scientifique exceptionnel RA Fisher : ses vues sur l’eugénisme et la race. Hérédité, 126(4), 565-576.

Khuyagbaatar, J., Yakushev, A., Düllmann, CE, Ackermann, D., Andersson, LL, Asai, M.,… et Yakusheva, V. (2014). Réaction de fusion Ca 48+ Bk 249 conduisant à l’élément Z= 117 : Db 270 en désintégration α à longue durée de vie et découverte de Lr 266. Lettres d’examen physique, 112(17), 172501.

Positifs, comparaisons multiples HMF : corrections de Bonferroni et taux de fausses découvertes.