Comprendre l’utilisateur de l’IA générative | Vers la science des données

dans certaines conversations intéressantes récemment sur la conception d’outils basés sur LLM pour les utilisateurs finaux, et l’une des questions importantes en matière de conception de produits que cela soulève est « que savent les gens de l’IA ? C’est important car, comme tout concepteur de produit vous le dira, vous devez comprendre l’utilisateur afin de réussir à créer quelque chose qu’il pourra utiliser. Imaginez si vous construisiez un site Web et que vous pensiez que tous les visiteurs parleraient couramment le mandarin, vous écriviez donc le site dans cette langue, mais il s’est avéré que vos utilisateurs parlaient tous espagnol. C’est comme ça, car même si votre site peut être incroyable, vous l’avez construit avec une hypothèse fatalement erronée et, par conséquent, vous avez rendu beaucoup moins de chances de réussir.

Ainsi, lorsque nous construisons des outils basés sur le LLM pour les utilisateurs, nous devons prendre du recul et examiner comment ces utilisateurs conçoivent les LLM. Par exemple:

- Ils ne savent peut-être rien du fonctionnement des LLM.

- Ils ne réalisent peut-être pas qu’il existe des LLM qui sous-tendent les outils qu’ils utilisent déjà.

- Ils peuvent avoir des attentes irréalistes quant aux capacités d’un LLM, en raison de leurs expériences avec des agents aux fonctionnalités très robustes.

- Ils peuvent avoir un sentiment de méfiance ou d’hostilité à l’égard de la technologie LLM.

- Ils peuvent avoir différents niveaux de confiance dans ce que dit un LLM en fonction d’expériences passées particulières.

- Ils peuvent s’attendre à des résultats déterministes même si les LLM ne fournissent pas cela.

La recherche utilisateur est une partie extrêmement importante de la conception de produits, et je pense que c’est une véritable erreur de sauter cette étape lorsque nous construisons des outils basés sur LLM. Nous ne pouvons pas supposer que nous savons comment notre public particulier a vécu les LLM dans le passé, et nous ne pouvons en particulier pas supposer que nos propres expériences sont représentatives des leurs.

Profils utilisateur

Heureusement, il existe de bonnes recherches sur ce sujet pour nous guider. Certains archétypes de perspectives d’utilisateurs peuvent être trouvés dans le cadre à quatre personnes développé par Cassandra Jones-VanMieghem, Amanda Papandreou et Levi Dolan de la faculté de médecine de l’Université d’Indiana.

Ils proposent (dans le contexte de la médecine, mais je pense que cela peut être généralisé) ces quatre catégories :

Utilisateur inconscient (ne sait pas/ne s’en soucie pas)

- Un utilisateur qui ne pense pas vraiment à l’IA et ne la considère pas comme pertinente dans sa vie entrerait dans cette catégorie. Ils auraient naturellement une compréhension limitée de la technologie sous-jacente et ne seraient pas très curieux d’en savoir plus.

Utilisateur évitant (l’IA est dangereuse)

- Cet utilisateur a une vision globalement négative de l’IA et trouverait la solution avec beaucoup de scepticisme et de méfiance. Pour cet utilisateur, toute offre de produits IA pourrait avoir un effet très préjudiciable sur la relation avec la marque.

Passionné d’IA (l’IA est toujours bénéfique)

- Cet utilisateur a des attentes élevées à l’égard de l’IA : il est enthousiasmé par l’IA, mais ses attentes peuvent être irréalistes. Les utilisateurs qui s’attendent à ce que l’IA prenne en charge toutes les corvées ou soit capable de répondre à n’importe quelle question avec une précision parfaite pourraient trouver leur place ici.

Utilisateur d’IA informé (autorisé)

- Cet utilisateur a une perspective réaliste et possède probablement un niveau généralement élevé de connaissances informationnelles. Ils peuvent utiliser une stratégie « faire confiance mais vérifier » où les citations et les preuves des affirmations d’un LLM sont importantes pour eux. Comme l’indiquent les auteurs, cet utilisateur ne fait appel à l’IA que lorsque cela est utile pour une tâche particulière.

En m’appuyant sur ce cadre, je dirais que les points de vue excessivement optimistes et excessivement pessimistes sont tous deux souvent basés sur un manque de connaissances sur la technologie, mais ils ne représentent pas du tout le même type d’utilisateur. La combinaison du niveau d’information et du sentiment (à la fois la force et la nature qualitative) crée ensemble le profil de l’utilisateur. Mon interprétation est un peu différente de ce que suggèrent les auteurs, à savoir que les passionnés sont bien informés, car je dirais en fait que les attentes irréalistes quant aux capacités de l’IA sont souvent fondées sur un manque de connaissances ou une consommation d’informations déséquilibrée.

Cela nous donne beaucoup de matière à réflexion lorsqu’il s’agit de concevoir de nouvelles solutions LLM. Parfois, les développeurs de produits peuvent tomber dans le piège de supposer que le niveau d’information est le seul axe et d’oublier que le sentiment social à l’égard de cette technologie varie considérablement et peut avoir tout autant d’influence sur la façon dont un utilisateur reçoit et expérimente ces produits.

Pourquoi cela arrive

Cela vaut la peine de réfléchir un peu aux raisons de ce large éventail de profils d’utilisateurs, et en particulier de sentiments. De nombreuses autres technologies que nous utilisons régulièrement n’inspirent pas autant de polarisation. Les LLM et autres IA génératives sont relativement nouveaux pour nous, cela fait donc certainement partie du problème, mais il existe des aspects qualitatifs de l’IA générative qui sont particulièrement distinctifs et peuvent avoir un impact sur la façon dont les gens réagissent.

Pinski et Benlian ont des travaux intéressants sur ce sujet, notant que les caractéristiques clés de l’IA générative peuvent perturber la manière dont les chercheurs en interaction homme-machine s’attendent à ce que ces relations fonctionnent – je recommande fortement de lire leur article.

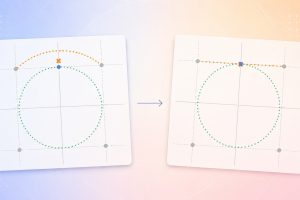

Non-déterminisme

À mesure que le calcul fait désormais partie de notre vie quotidienne au cours des dernières décennies, nous avons pu compter sur une certaine reproductibilité. Lorsque vous cliquez sur une touche ou appuyez sur un bouton, la réponse de l’ordinateur sera à chaque fois la même, plus ou moins. Cela confère un sentiment de fiabilité, dans lequel nous savons que si nous apprenons les bons modèles pour atteindre nos objectifs, nous pouvons compter sur la cohérence de ces modèles. L’IA générative rompt ce contrat en raison de la nature non déterministe des résultats. Le profane moyen utilisant la technologie a peu d’expérience avec le concept selon lequel la même frappe de touche ou la même requête renvoie des résultats inattendus et toujours différents, ce qui brise naturellement la confiance qu’ils pourraient autrement avoir. Le non-déterminisme a bien sûr une très bonne raison, et une fois que vous comprenez la technologie, ce n’est qu’une autre caractéristique de la technologie avec laquelle travailler, mais à un stade moins informé, cela pourrait être problématique.

Impénétrabilité

En réalité, ce n’est qu’un autre mot pour « boîte noire ». La nature des réseaux neuronaux qui sous-tendent une grande partie de l’IA générative est telle que même ceux d’entre nous qui travaillent directement avec la technologie n’ont pas la capacité d’expliquer pleinement pourquoi un modèle « fait ce qu’il fait ». Nous ne pouvons pas consolider et expliquer la pondération de chaque neurone dans chaque couche du réseau, car c’est tout simplement trop complexe et comporte trop de variables. Il existe bien sûr de nombreuses solutions d’IA explicables utiles qui peuvent nous aider à comprendre les leviers qui ont un impact sur une seule prédiction, mais une explication plus large du fonctionnement de ces technologies n’est tout simplement pas réaliste. Cela signifie que nous devons accepter un certain niveau d’inconnaissabilité, ce qui peut être très difficile à accepter, tant pour les scientifiques que pour les profanes curieux.

Autonomie

La volonté croissante d’intégrer l’IA générative aux agents semi-autonomes semble nous pousser à faire fonctionner ces outils avec de moins en moins de surveillance et de contrôle de la part des utilisateurs humains. Dans certains cas, cela peut être très utile, mais cela peut aussi créer de l’anxiété. Étant donné ce que nous savons déjà sur le caractère non déterministe et non explicable de ces outils à grande échelle, l’autonomie peut sembler dangereuse. Si nous ne savons pas toujours ce que fera le modèle, et si nous ne comprenons pas vraiment pourquoi il fait ce qu’il fait, certains utilisateurs pourraient être pardonnés de dire que cela ne semble pas être une technologie sûre pour permettre de fonctionner sans supervision. Nous travaillons constamment au développement de stratégies d’évaluation et de tests pour tenter de prévenir les comportements indésirables, mais un certain nombre de risques sont inévitables, comme c’est le cas pour toute technologie probabiliste. À l’opposé, une partie de l’autonomie de l’IA générative peut créer des situations dans lesquelles les utilisateurs ne reconnaissent pas du tout l’implication de l’IA dans une tâche donnée. Il peut fonctionner silencieusement en coulisses et un utilisateur peut ne pas avoir conscience de sa présence. Cela fait partie d’un domaine de préoccupation beaucoup plus vaste dans lequel les résultats de l’IA deviennent impossibles à distinguer du matériel créé organiquement par les humains.

Ce que cela signifie pour le produit

Cela ne signifie pas pour autant que la création de produits et d’outils faisant appel à l’IA générative est un échec, bien sûr. Cela signifie, comme je le dis souvent, que nous devons examiner attentivement si l’IA générative est adaptée au problème ou à la tâche qui nous attend, et nous assurer que nous avons pris en compte les risques ainsi que les récompenses possibles. C’est toujours la première étape : assurez-vous que l’IA est le bon choix et que vous êtes prêt à accepter les risques liés à son utilisation.

Après cela, voici ce que je recommande aux concepteurs de produits :

- Effectuer une recherche rigoureuse sur les utilisateurs. Découvrez quelles sont les distributions des profils d’utilisateurs décrits ci-dessus dans votre base d’utilisateurs et planifiez comment le produit que vous construisez les prendra en charge. Si vous avez une part importante d’utilisateurs évitants, planifiez une stratégie d’information pour faciliter l’adoption et envisagez de déployer les choses lentement pour éviter un choc pour la base d’utilisateurs. D’un autre côté, si vous avez beaucoup d’utilisateurs enthousiastes, assurez-vous d’être clair sur les limites des fonctionnalités que votre outil fournira, afin de ne pas obtenir une réaction du type « votre IA est nulle ». Si les gens attendent des résultats magiques de l’IA générative et que vous ne pouvez pas les fournir, car vous devez respecter d’importantes limitations de sûreté, de sécurité et de fonctionnalité, cela posera un problème pour votre expérience utilisateur.

- Construisez pour vos utilisateurs: Cela peut sembler évident, mais je dis essentiellement que vos recherches sur les utilisateurs devraient profondément influencer non seulement l’apparence et la convivialité de votre produit d’IA générative, mais aussi sa construction et ses fonctionnalités réelles. Vous devez aborder les tâches d’ingénierie avec une vision fondée sur des preuves de ce dont ce produit doit être capable et des différentes manières dont vos utilisateurs peuvent l’aborder.

- Donner la priorité à l’éducation. Comme je l’ai déjà mentionné, il sera important d’éduquer vos utilisateurs sur la solution que vous proposez, qu’elle soit positive ou négative. Parfois, nous supposons que les gens « comprendront tout simplement » et nous pouvons sauter cette étape, mais c’est une erreur. Vous devez définir des attentes de manière réaliste et répondre de manière préventive aux questions qui pourraient provenir d’un public sceptique pour garantir une expérience utilisateur positive.

- Ne le force pas. Dernièrement, nous constatons que les produits logiciels que nous avons utilisés avec bonheur dans le passé ajoutent des fonctionnalités d’IA générative et les rendent obligatoires. J’ai déjà écrit sur la façon dont les forces du marché et les modèles de l’industrie de l’IA rendent cela possible, mais cela ne rend pas cela moins dommageable. Vous devez être prêt à ce qu’un groupe d’utilisateurs, aussi petit soit-il, veuille refuser d’utiliser un outil d’IA générative. Cela peut être dû à un sentiment critique, à une réglementation en matière de sécurité ou simplement à un manque d’intérêt, mais respecter cela est le bon choix pour préserver et protéger la réputation de votre organisation et ses relations avec cet utilisateur. Si votre solution est utile, intéressante, bien testée et bien communiquée, vous pourrez peut-être accroître l’adoption de l’outil au fil du temps, mais l’imposer aux gens ne vous aidera pas.

Conclusion

En fin de compte, bon nombre de ces leçons constituent de bons conseils pour toutes sortes de travaux techniques de conception de produits. Cependant, je tiens à souligner à quel point l’IA générative change la façon dont les utilisateurs interagissent avec la technologie, et le changement significatif qu’elle représente pour nos attentes. Par conséquent, il est plus important que jamais que nous examinions de très près l’utilisateur et son point de départ, avant de lancer des produits comme celui-ci dans le monde. Comme de nombreuses organisations et entreprises apprennent à leurs dépens, un nouveau produit est une chance de faire bonne impression, mais cette impression peut être aussi bien terrible que bonne. Vos opportunités d’impressionner sont importantes, mais vos opportunités de ruiner votre relation avec les utilisateurs, d’écraser leur confiance en vous et de vous mettre en place avec un sérieux travail de contrôle des dégâts à accomplir le sont également. Alors soyez prudent et consciencieux au début ! Bonne chance!

En savoir plus sur mon travail sur www.stephaniekirmer.com.

Lectures complémentaires

https://scholarworks.indianapolis.iu.edu/items/4a9b51db-c34f-49e1-901e-76be1ca5eb2d

https://www.sciencedirect.com/science/article/pii/S2949882124000227

https://www.nature.com/articles/s41746-022-00737-z

https://www.tandfonline.com/doi/full/10.1080/10447318.2024.2401249#d1e231

https://www.stephaniekirmer.com/writing/canwesavetheaieconomy